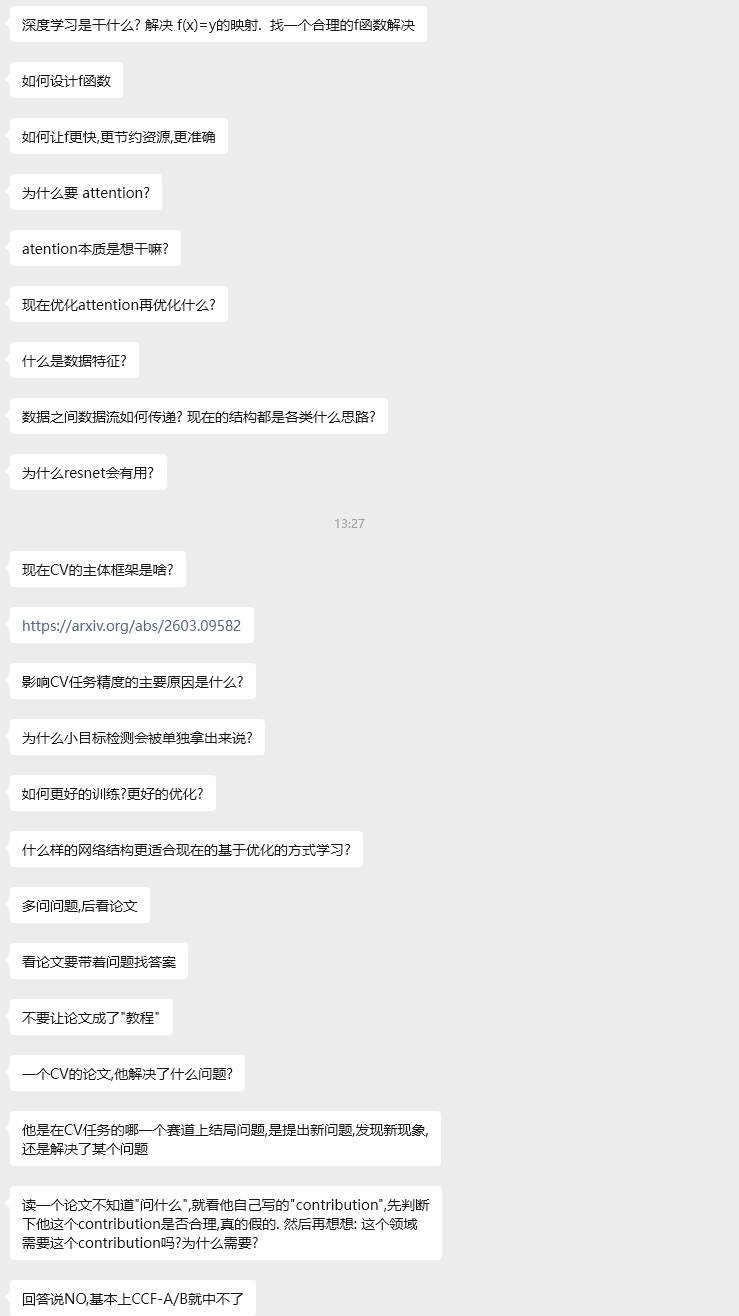

【从会用模型到理解CV4】现代 CV 框架到底在优化什么?从 CNN 到 Transformer,再到多尺度融合

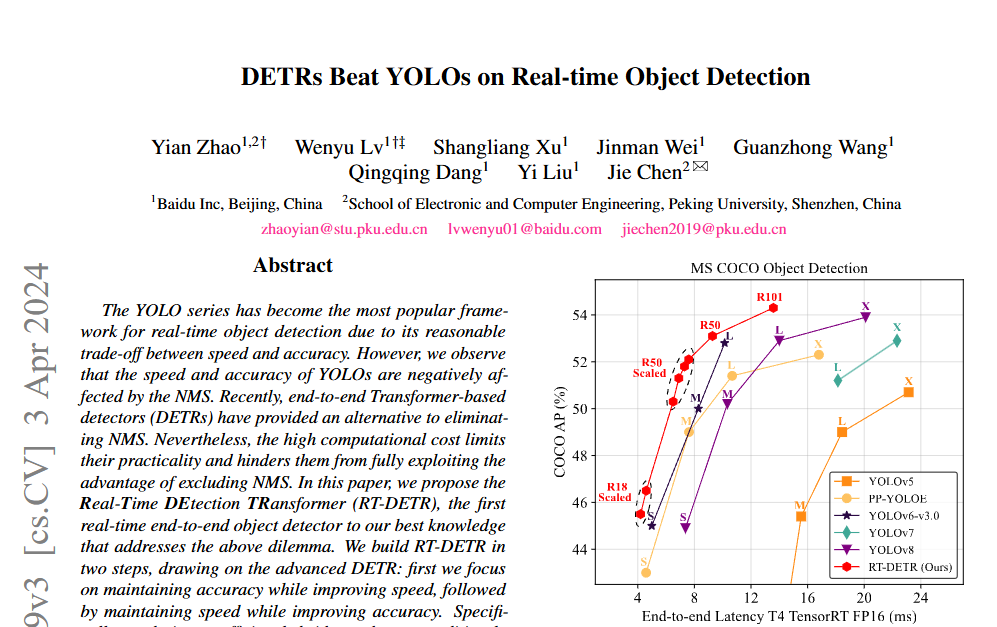

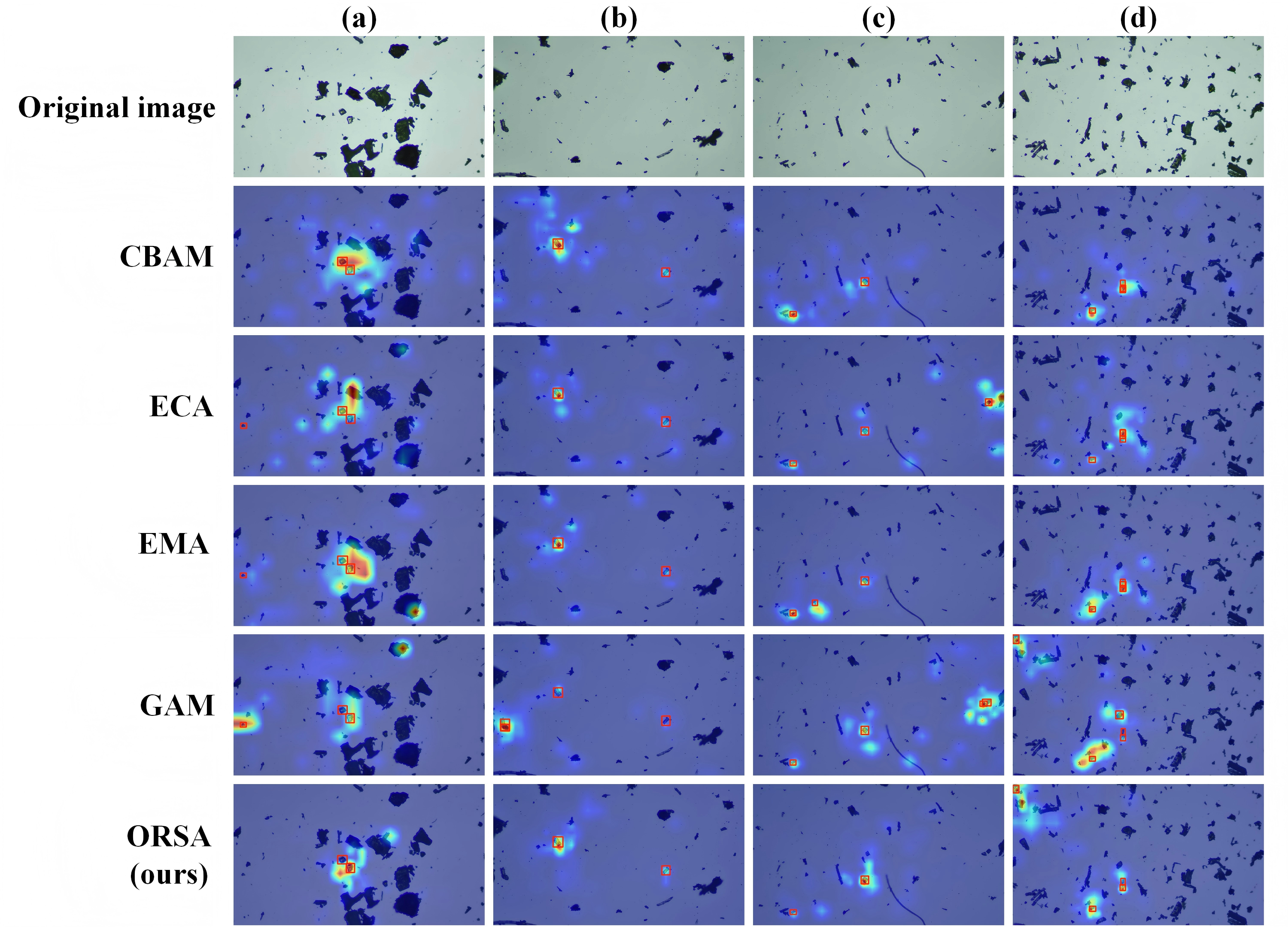

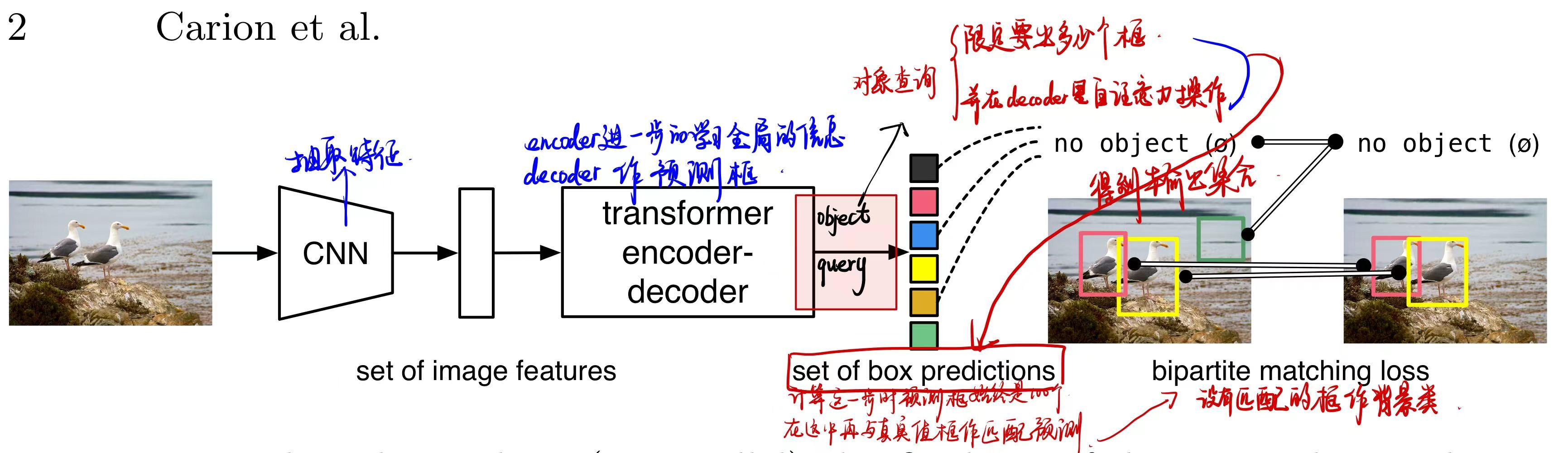

在计算机视觉的快速发展中,我们看到了无数的模型结构创新。从最早的卷积神经网络(CNN),到更复杂的 ResNet、FPN,再到近年来掀起热潮的 Transformer,这些框架各自解决了不同的问题,并为视觉任务提供了新的思路。 但你有没有想过: 所有这些架构创新,背后的核心目标是什么?它们到底在优化什么? 这篇文章的核心目标是,帮助你从更本质的角度理解现今主流 CV 框架的设计方向。随着模型不